研究背景

教師付き学習の多くは訓練データとテストデータが独立かつ同分布(IID) であるという仮定に基づいている。一方で、現実的には訓練データとテストデータの分布が異なる可能性がある。この問題は、自律走行車の安全な実現や、金融、安全保障、医療など性能の安定性が求められる分野では特に重要である。このような状況でモデルを学習することは、近年多くの分野の研究者にとって魅力的であり、領域汎化あるいは分布外汎化と呼ばれている。

研究課題

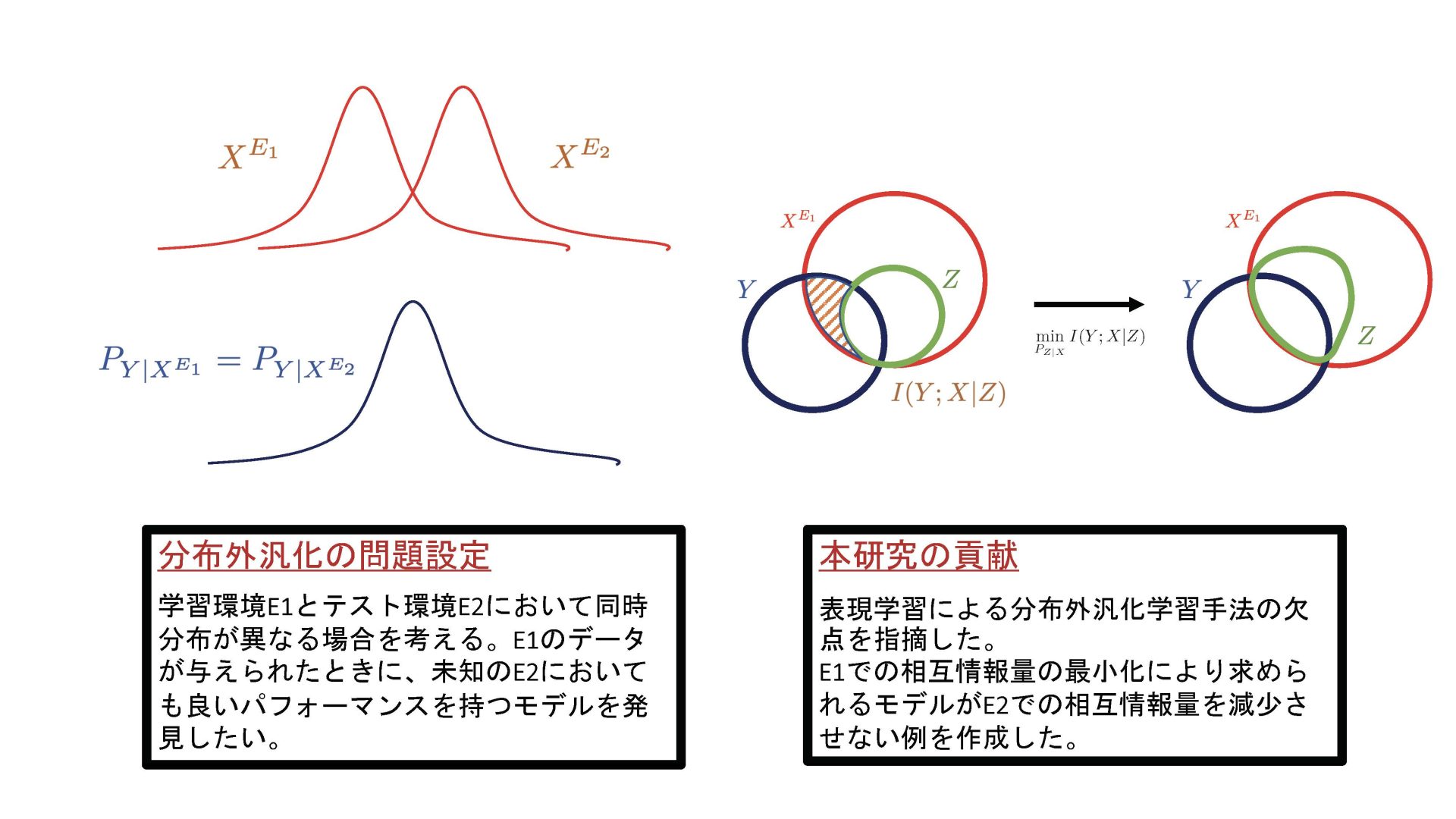

未知の分布に従うテストデータは利用できないため、研究者はこの潜在的な困難を克服する必要がある。この困難を克服するために、(1)訓練時、テスト時において不変な関係を学習する方法、(2)最もパフォーマンスを下げるテスト環境を想定する統計的手法、(3)敵対的学習に基づく方法などがある。

(1)の手法の一つに潜在変数を導入して学習モデルを2 つの関数に分解する表現学習に基づく手法があり、情報理論の観点から理論的な解析がされている。一方で、解析結果は楽観的な仮定に基づいているため、未知の分布で大きなパフォーマンスの低下をもたらす可能性がある。

研究目的

本研究では、(1)における表現学習に基づく手法を解析し学習が上手くいかないような場合を考え、分布外汎化における表現学習による手法をより柔軟にすることを目的にする。

自動運転車の安全性の向上・金融、セキュリティ、医療などにおけるモデルの安定性の向上

| 氏名 | 専攻 | 研究室 | 役職/学年 |

|---|---|---|---|

| 高橋 元気 | システム科学専攻 | 情報数理システム分野 | 修士2回生 |

| 田中 利幸 | システム科学専攻 | 情報数理システム分野 | 教授 |